Informationstheorie

Tuesday, August 24th, 2010 | Author: Konrad Voelkel

Ich bin hier gerade in Rot an der Rot in einem Seminar über die Rolle der Informationstheorie in den Naturwissenschaften. Mein Vortrag hat heute statt gefunden, es war der vierte von zwanzig und behandelte bedingte Entropie, zusammen mit den notwendigen Voraussetzungen aus der diskreten Wahrscheinlichkeitstheorie, der Begrifflichkeit der Entropie (Information) an sich und zahlreiche Anwendungen.

Vorgetragen habe ich mit Folien (am Beamer), es dauerte etwa 90 Minuten und ging am Ende ein bisschen zu schnell. Ich habe auch noch ca. 90 Backup-Folien mit deutlich mehr Informationen vorbereitet, bevor ich den konkreten Vortrag daraus destilliert habe. Die Folien sind mit der Latex-Beamer-class erstellt.

Die Folien zum Vortrag (ca. 35, zum Vortragen optimiert) gibt es hier, und

die deutlich umfangreichere Version (ca. 90, mit Text vollgestopft) gibt es hier.

Beides gibt es natürlich ohne Gewähr, allerdings habe ich (meines Wissens nach) alle (2) Fehler korrigiert, die das Publikum gefunden hat.

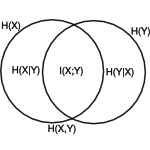

Quellen waren die Paper von Shannon und Weaver, das Buch von Brillouin (Science and Information Theory) und meine alten Notizen zur Stochastik aus dem Vordiplom (zusammen mit dem einführenden Buch von Hans-Otto Georgii, das ich immer noch gern zum Nachschlagen verwende). Einzelne Grafiken stammen von Wikipedia, andere habe ich gezeichnet (und auch als public domain in Wikipedia eingebracht). Meine Zeichnungen habe ich mit Inkscape erstellt.

Viel Spaß damit!

Category: German, Mathematics | Comments off